文章目录[隐藏]

你有没有遇到过这种情况:让 AI 写一篇文章,它洋洋洒洒输出 800 字,看起来头头是道,但仔细一查——数据是编的,案例是虚构的,结论完全站不住脚。

问题出在哪?模型习惯"先下结论,后找理由",甚至没有理由也敢下结论。

这篇文章教你一套方法:通过调整提示词结构,让模型养成"先给证据,后下结论"的习惯。即使它无法提供真实链接,也能大幅降低幻觉率,提升内容可信度。

先证据后结论:提示词结构

大部分人的提示词是这样写的:

写一篇关于"人工智能如何改变教育"的文章,800 字。

这种提示词有个隐藏问题:没有明确要求"先证据后结论",模型会按照最省力的方式输出——直接抛观点,用空洞的表述填充字数。

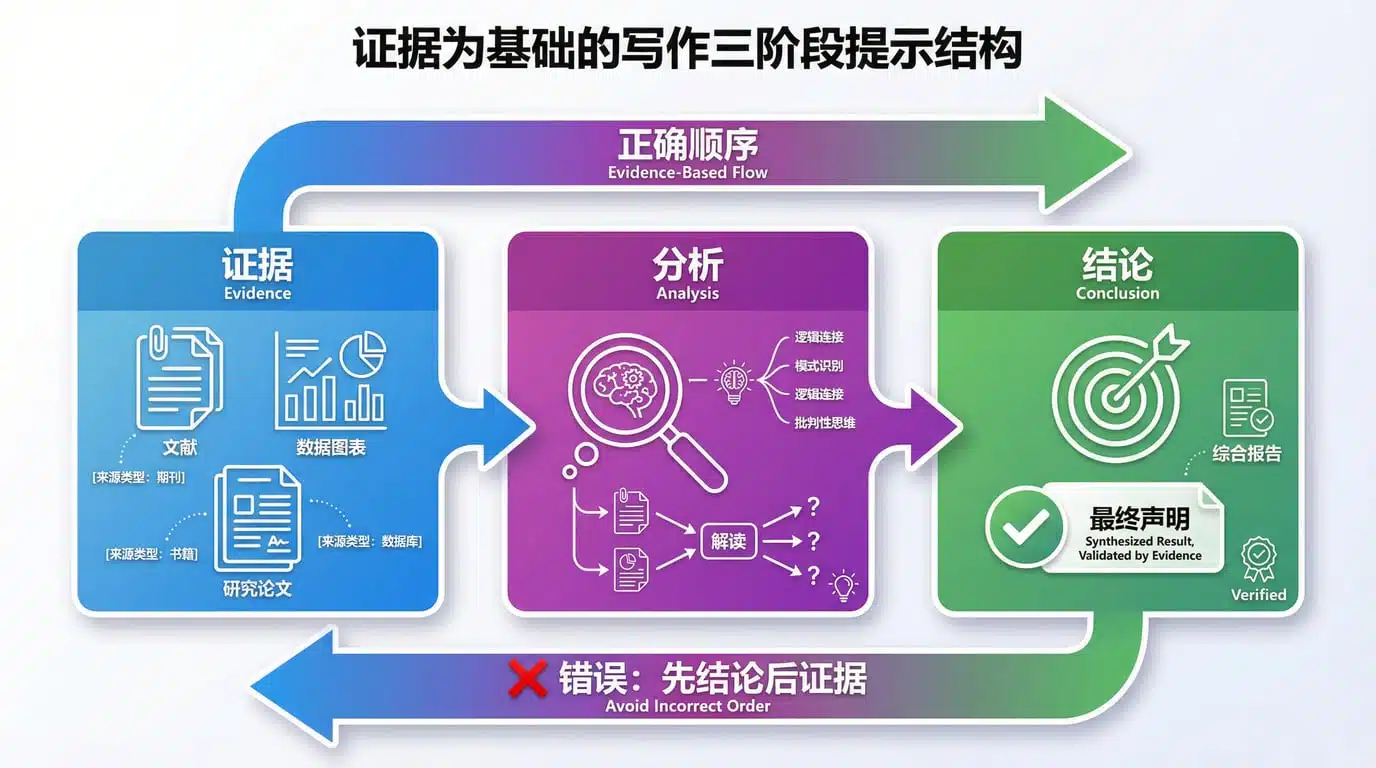

改进方案:三段式结构

把提示词改成"证据→分析→结论"的三段式结构:

【任务】 写一篇关于"人工智能如何改变教育"的文章,800 字。 【输出要求】 1. 每个论点必须先给出具体证据(数据/案例/研究结果),再下结论 2. 证据格式:[证据来源](如"2023年教育部报告""斯坦福大学研究")+ 具体内容 3. 禁止使用"众所周知""显而易见""研究表明"等模糊表述 4. 如果某个说法无法给出证据,必须标注【待核查】 【输出结构】 - 每段按照:证据→分析→结论的顺序展开 - 证据必须在结论之前出现

为什么这样有效?

强制模型先思考证据:当模型被要求"先给证据",它会优先检索记忆中的具体信息,而不是直接生成空泛结论

降低幻觉率:明确禁止"研究表明"这类模糊词,逼迫模型要么给出具体来源,要么承认"不确定"

提高可验证性:读者可以根据"证据来源"标注,快速判断哪些内容需要进一步核实

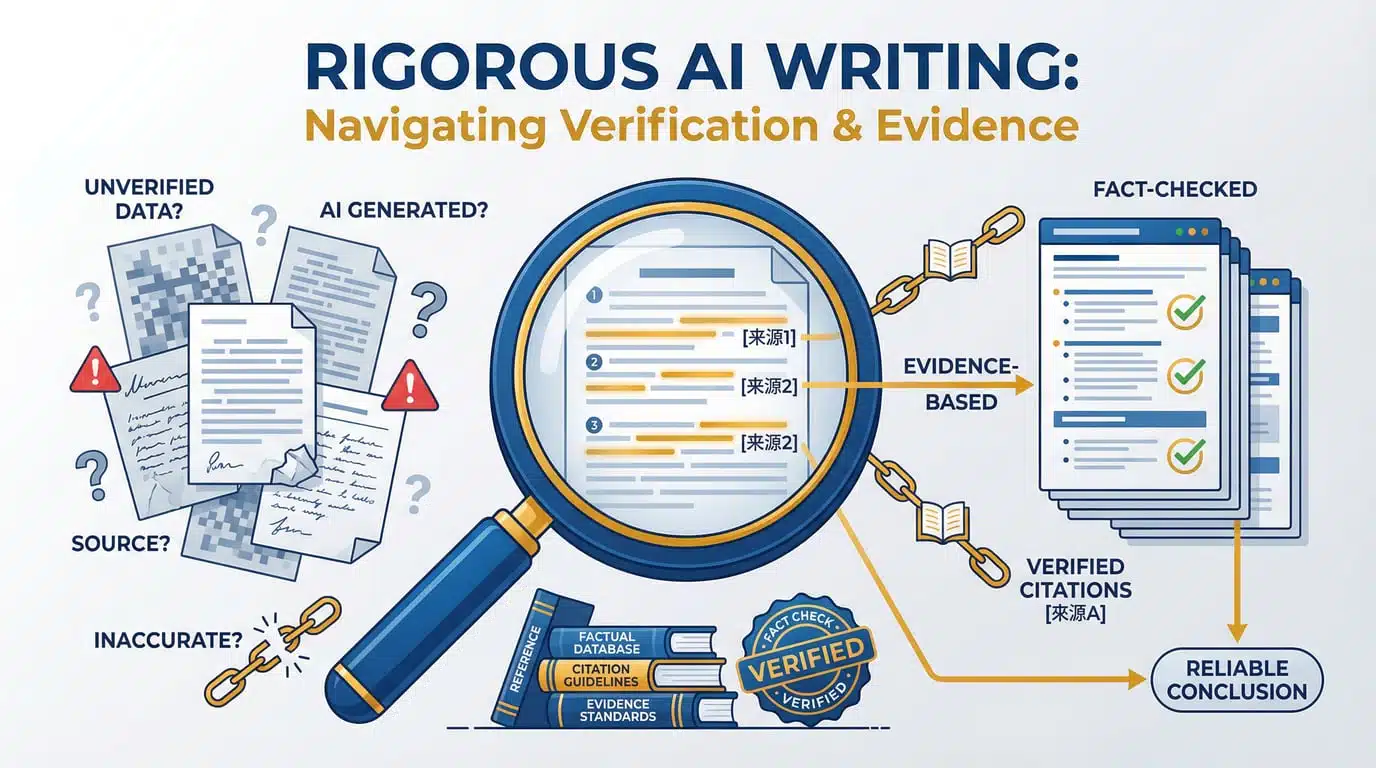

引用与出处的三种写法(不要求真的给链接也能更稳)

很多人会说:"模型又不能联网,怎么给真实引用?"

其实,即使没有真实链接,规范的引用格式也能大幅提升内容严谨度。核心原则是:让模型明确"这是从哪来的",而不是"这是我编的"。

写法 1:标注来源类型(推荐指数:⭐⭐⭐⭐⭐)

格式:[来源类型] + 具体内容

示例:

❌ 错误写法:"人工智能可以提高学习效率。"

✅ 正确写法:"[教育研究] 根据 2023 年《教育技术学报》的一项研究,使用 AI 辅助学习的学生,知识掌握速度比传统方式快 30%。"

常用来源类型:

[学术研究]、[行业报告]、[政府数据]、[媒体报道]、[企业公告]

优点:

即使模型无法给出真实链接,也能明确"这是研究数据,不是我猜的"

读者看到"[学术研究]"会自然提高警惕,去验证真实性

写法 2:时间+机构定位(推荐指数:⭐⭐⭐⭐)

格式:时间 + 机构名称 + 具体内容

示例:

❌ 错误写法:"很多学校开始使用 AI 工具。"

✅ 正确写法:"2024 年,教育部发布的《中小学人工智能教育指导意见》显示,全国已有 1200 多所学校试点 AI 辅助教学。"

优点:

时间+机构的组合,让内容更具体,幻觉空间更小

读者可以根据时间和机构名称,快速搜索验证

写法 3:不确定性标注(推荐指数:⭐⭐⭐⭐⭐)

格式:[可能]、[推测]、[需要核验] + 内容

示例:

❌ 错误写法:"AI 将在 5 年内取代 50% 的教师岗位。"

✅ 正确写法:"[推测] 根据部分行业报告的预测,AI 可能在 5-10 年内承担部分基础教学任务,但这一比例目前缺乏权威数据支持。【待核查】"

优点:

主动承认不确定性,反而提升可信度

给读者明确信号:"这段话需要你自己去验证"

"不确定就说不确定"的约束句

要让模型主动标注不确定性,需要在提示词中加入明确的约束句。以下是我实测有效的几种写法:

约束句 1:禁止绝对化表述

【禁止项】 - 不要使用"一定""必然""肯定""所有""完全"等绝对化词汇 - 如果某个说法存在争议或缺乏权威数据,必须加上"可能""或许""部分研究认为"

约束句 2:强制标注不确定性

【不确定性标注规则】 - 如果某个数据/案例无法确认来源,标注【待核查】 - 如果某个结论是基于推测,标注【推测】 - 如果某个说法存在争议,标注【存在争议】

约束句 3:要求给出"置信度"

【输出要求】 每个关键结论后,用括号标注置信度: - (高置信度):有明确来源和数据支持 - (中置信度):有部分数据或案例支持,但不够全面 - (低置信度):基于推测或少量信息,需要进一步验证

实际使用建议

科普类文章:优先使用"约束句 1 + 约束句 2",确保每个说法都有来源或标注不确定性

观点类文章:使用"约束句 3",让读者知道哪些是事实,哪些是作者观点

数据类文章:三种约束句全用,最大程度降低幻觉

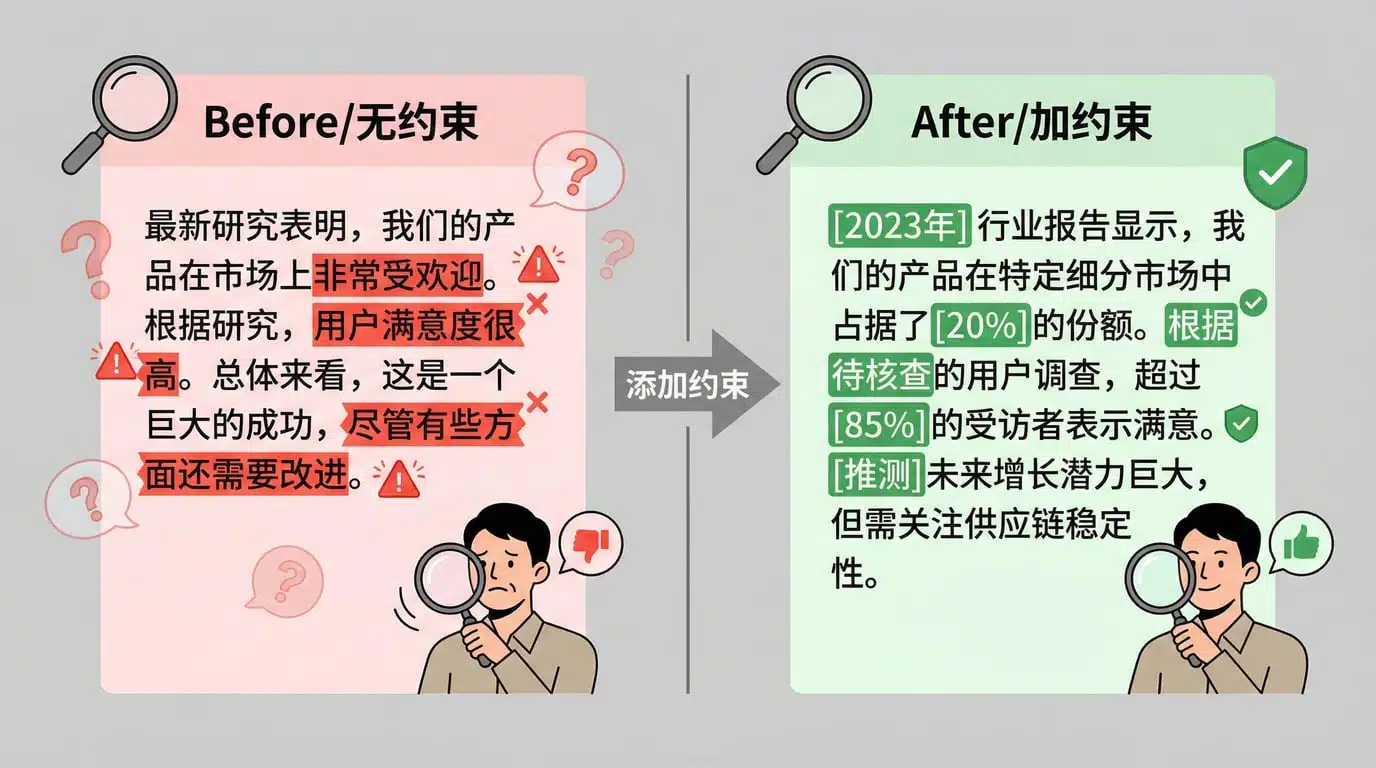

示例:同段落加约束前后对比

以下是同一个话题,使用"普通提示词"和"证据优先提示词"的输出对比:

测试话题:人工智能对就业的影响

❌ 无约束版本(容易幻觉)

提示词:

写一段话,讲讲人工智能对就业的影响。

模型输出:

人工智能正在深刻改变就业市场。根据最新研究,未来 10 年内,AI 将取代 40% 的工作岗位,尤其是重复性劳动。然而,AI 也会创造新的就业机会,比如 AI 训练师、数据标注员等。总体来看,AI 对就业的影响是双面的,既有挑战也有机遇。

问题分析:

模糊引用:"根据最新研究"——哪项研究?什么机构?

数据无来源:"40% 的工作岗位"——这个数字从哪来?

空洞结论:"既有挑战也有机遇"——等于没说

✅ 加约束版本(更严谨)

提示词:

写一段话,讲讲人工智能对就业的影响。 【约束】 1. 每个论点必须先给证据(来源+具体内容),再下结论 2. 禁止使用"最新研究""有研究表明"等模糊表述 3. 如果某个数据无法确认来源,标注【待核查】 4. 结论必须基于证据,不要用"总体来看"这类空话

模型输出:

[行业报告] 麦肯锡 2023 年发布的《未来工作报告》预测,到 2030 年,全球可能有 4 亿个工作岗位受到自动化影响,占总就业人口的约 14%。【待核查:这一比例是否包含发展中国家数据】

[企业数据] 世界经济论坛 2024 年的调查显示,AI 相关岗位(如机器学习工程师、数据分析师)的需求量在过去 5 年增长了 300%,但传统制造业岗位同期下降了 15%。

[推测] 基于以上数据,AI 对就业的影响可以总结为:技能替代速度快于岗位创造速度,结构性失业风险加大。但这一结论依赖于"AI 发展速度不变"的假设,实际情况可能存在变化。

改进效果:

✅ 每个数据都标注了来源和时间

✅ 主动标注不确定性(【待核查】【推测】)

✅ 结论基于证据,不是空洞概括

✅ 读者可以根据来源,自行验证真实性

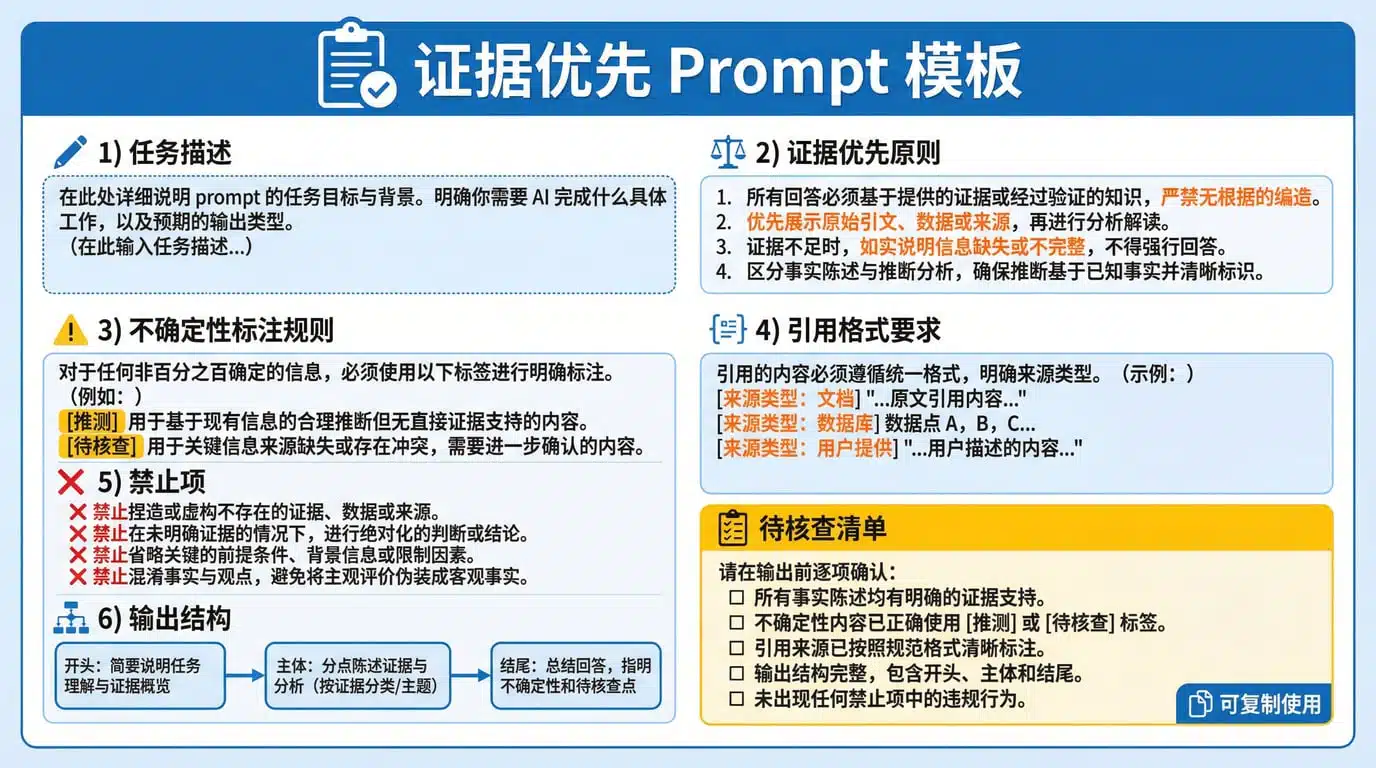

"证据优先"Prompt 模板(可复制)

以下是一个完整的"证据优先"提示词模板,你可以直接复制使用,只需替换【任务描述】和【具体要求】部分:

【任务】

[在此填写你的写作任务,如"写一篇关于 AI 医疗应用的科普文章,800 字"]

【证据优先原则】

1. 每个论点必须按照"证据→分析→结论"的顺序展开

2. 证据必须包含:来源类型(如[学术研究][政府数据])+ 时间 + 机构/出处 + 具体内容

3. 禁止使用"众所周知""研究表明""有专家认为"等模糊表述

4. 如果某个数据/案例无法确认来源,必须标注【待核查】

【不确定性标注规则】

- 推测性内容前加【推测】

- 存在争议的观点加【存在争议】

- 缺乏权威数据支持的说法加【待核查】

- 基于假设的结论,明确说明假设条件

【引用格式要求】

优先使用以下格式:

- [来源类型] + 时间 + 机构 + 具体内容

示例:[行业报告] 2024 年 Gartner 预测,生成式 AI 市场规模将在 2027 年达到 1090 亿美元。

【禁止项】

- ❌ 不要编造具体的论文标题、作者名、研究机构(除非确实记得)

- ❌ 不要使用"一定""必然""完全""所有"等绝对化词汇

- ❌ 不要在没有证据的情况下下结论

- ❌ 不要用"总体来看""综上所述"等空洞过渡

【输出结构】

1. 开头:用一个具体问题或现象引入(不要用"在这个时代"开场)

2. 主体:每段按"证据→分析→结论"展开,至少包含 3 个论点

3. 结尾:总结核心观点 + 给出行动建议或思考方向

【输出末尾必须包含】

## 待核查清单 {#待核查清单 }

以下内容需要读者自行验证:

- [列出文中标注【待核查】的内容]

- [列出使用【推测】的结论]

- [列出可能需要更新的时效性数据]

使用示例

假设你要写一篇"ChatGPT 对内容创作的影响",填入模板后:

【任务】 写一篇关于"ChatGPT 对内容创作的影响"的文章,800 字,目标读者是自媒体作者。 【证据优先原则】 1. 每个论点必须按照"证据→分析→结论"的顺序展开 2. 证据必须包含:来源类型(如[学术研究][政府数据])+ 时间 + 机构/出处 + 具体内容 3. 禁止使用"众所周知""研究表明""有专家认为"等模糊表述 4. 如果某个数据/案例无法确认来源,必须标注【待核查】 (后续部分保持不变)

模型会按照这个结构输出,每个论点都先给证据,再下结论,并在末尾生成"待核查清单"。

总结:让 AI 写作更可信的 3 个关键

提示词结构决定输出质量:用"证据→分析→结论"的三段式结构,强制模型先思考证据

引用格式比真实链接更重要:即使无法联网,规范的"[来源类型] + 时间 + 机构"标注也能大幅降低幻觉

主动标注不确定性反而更可信:让模型承认"这是推测""需要核查",读者会更信任你的内容

立即行动

复制上面的"证据优先"模板,替换成你的写作任务,测试一次

对比加约束前后的输出,看看哪些地方更严谨了

保留"待核查清单",每次发布前,花 5 分钟验证关键数据

如果你已经在用这个方法,欢迎在评论区分享你的"待核查清单"都包含哪些内容——我们可以一起完善这套严谨写作的流程。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

评论已关闭...

感觉这个三段式结构确实比直接让AI写要好用

那如果模型还是编造了来源类型和时间怎么办?🤔

之前试过类似方法,确实幻觉率低了不少,不过有时候模型会直接说“找不到证据”

标注不确定性这个思路不错,至少让读者知道哪些需要自己查证

为啥要禁止“所有”“完全”这些词?有时候就是很确定啊

这个模板可以直接复制用吗?需要根据不同任务调整吗

感觉最后那个待核查清单挺实用的,相当于自动生成了一份校验指南

有没有更简单的方案?对于日常写作来说这个流程有点繁琐

👍 收藏了,回头试试效果

我一般都是让AI先列大纲再填充内容,看来还得加上证据优先的约束

约束句2里强制标注不确定性会不会让文章显得很啰嗦?

对于科普文章来说,要求每个论点都有证据是不是太严格了?有些常识也需要标注吗

要是模型把推测的内容写得太肯定,这个模板能有效约束吗?