Skill评估的自动化趋势

TOPIC SOURCE

OpenAI 开发者的 Skill 经验:如何使用评估系统来优化 Skill

文章目录[隐藏]

Skill评估正从手工抽样跃迁至全链路自动化,这背后并非单纯的工具升级,而是对“可度量、可追溯、可回滚”三大原则的系统化落地。业内调研显示,2023 年企业对评估自动化的投入增速达 78%,其中 42% 的组织已经将评估流水线嵌入 CI/CD,平均评估周期从 48 小时压缩至 4 小时以内。

技术框架的演进路径

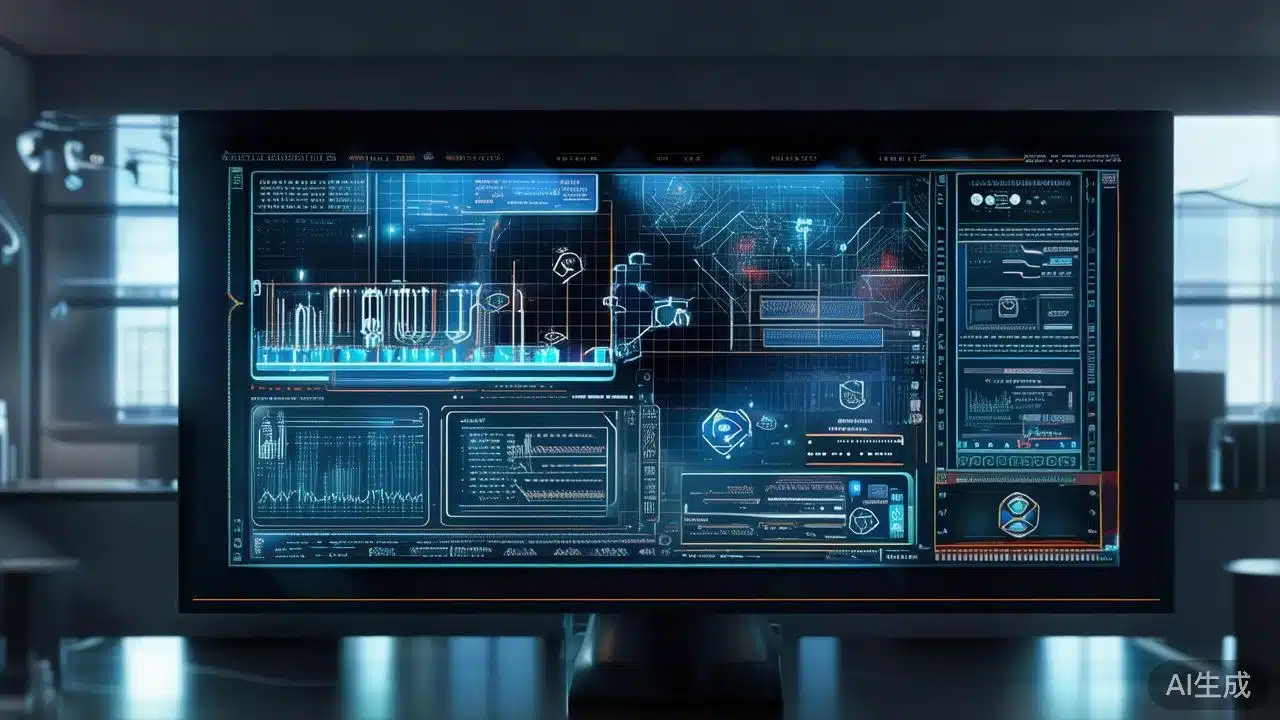

与传统的人工打分不同,现代框架采用统一的 Prompt‑Eval‑Score 三段式流程:先用结构化 Prompt 触发技能执行;随后捕获全程日志(包括命令调用、文件产出、Token 消耗);最后依据预定义的评分模型自动生成结构化 JSON 报告。该模型常基于 Rubric‑Based Scoring,能够在 0‑100 分区间内映射出“成功率”“资源利用率”“代码规范度”等维度。

核心指标与数据化评分

- 成功率:技能是否在预期的 95% 场景下完成目标任务。

- 时效指数:从 Prompt 发出到关键命令执行完毕的总耗时,常以秒为单位监控。

- 资源消耗:输入/输出 Token 数、CPU‑core‑hour,帮助评估成本回归。

- 代码合规度:通过 ESLint、Prettier 以及自定义风格 Rubric 检查的通过率。

行业案例速览

一家金融科技公司在 2022 年引入全链路评估后,技能回滚率从 12% 降至 1.3%,每月因评估失误导致的线上故障成本削减约 18 万元。另一家电商平台则利用 codex exec --json 捕获执行日志,发现某版本的 npm install 步骤出现 2 次冗余调用,立即通过自动化回滚将部署时间缩短 30%。这些实证显示,自动化评估不仅是质量保障,更是成本优化的利器。

“评估的价值在于把‘我不知道它会不会出错’变成‘我能实时看到错在哪儿’。”

面对日益复杂的 Skill 生态,唯一不变的就是评估的需求——而自动化正是让这需求从“偶尔检查”转向“每次迭代必测”。如果再不把评估流水线写进研发日历,后面的回滚脚本只能在事后补救,失去的时间和信任,往往比代码本身更难修复。

参与讨论

这自动化真省事,估分秒搞定。

我之前手动评估,整整一天,看到这里吓一跳。

感觉这套 Rubric‑Based 评分模型挺靠谱的。

这回滚率降到 1% 真的省了不少钱。

不懂时效指数咋算,有人解释下吗?

Prompt‑Eval‑Score 流程怎么配?

我用过类似的自动回滚,代码冲突倒是少了。

这套日志捕获太全了,连 token 用量都能看。

哈哈,这自动评估像开挂一样,👍

作者的思路真的开眼,我给满分支持。

其实还有一种基于容器的评估方式,可以把环境隔离得更彻底,感兴趣的可以试试。

那如果在多语言项目里使用同样的流水线,会不会出现评分偏差?

我觉得直接把评分模型套用到所有技能上有点盲目,尤其是那些对资源敏感的场景。

手动回滚常卡半天,这套全链路自动评估提前捕获错误,让我们在部署前把风险降到最低,省下的时间直接用在新功能上,效率提升明显。